3.2.1 音声メディア処理

テレビ会議システムで送受信される音声情報は,人間の話し声が基本です.しかし場合によっては音楽だったり,ラジオ番組やテレビ番組の音だったり,あるいは周囲の雑音の場合もあります.人間が聞き取れる音は最低20 Hz程度,最高20 kHz程度と言われています[3-2].

ITU-Tでは,音声信号を音声帯域により,次のようにクラス分けしています.

- 狭帯域音声: 300 Hz〜3.4 kHz -- アナログ電話の帯域

- 広帯域音声: 50 Hz〜7 kHz -- AM (Amplitude Modulation)ラジオ放送の帯域

- 超広帯域音声: 50 Hz〜14 kHz -- FM (Frequency Modulation)ラジオ放送の帯域

- フルバンド音声: 20 Hz〜21 kHz -- CD (Compact Disc)の帯域,サウンドとも呼ばれる

テレビ会議端末では複数の利用者を前提とすることから,音声の取り込みデバイスはマイクロホンが,出力デバイスにはスピーカが用いられます.これらデバイスで扱われる信号はアナログですので,端末装置の中でA/D (Analog to Digital)変換,D/A (Digital to Analog)変換が行われ,さらに音声codec (coder and decoder)により圧縮符号化,復号されます.

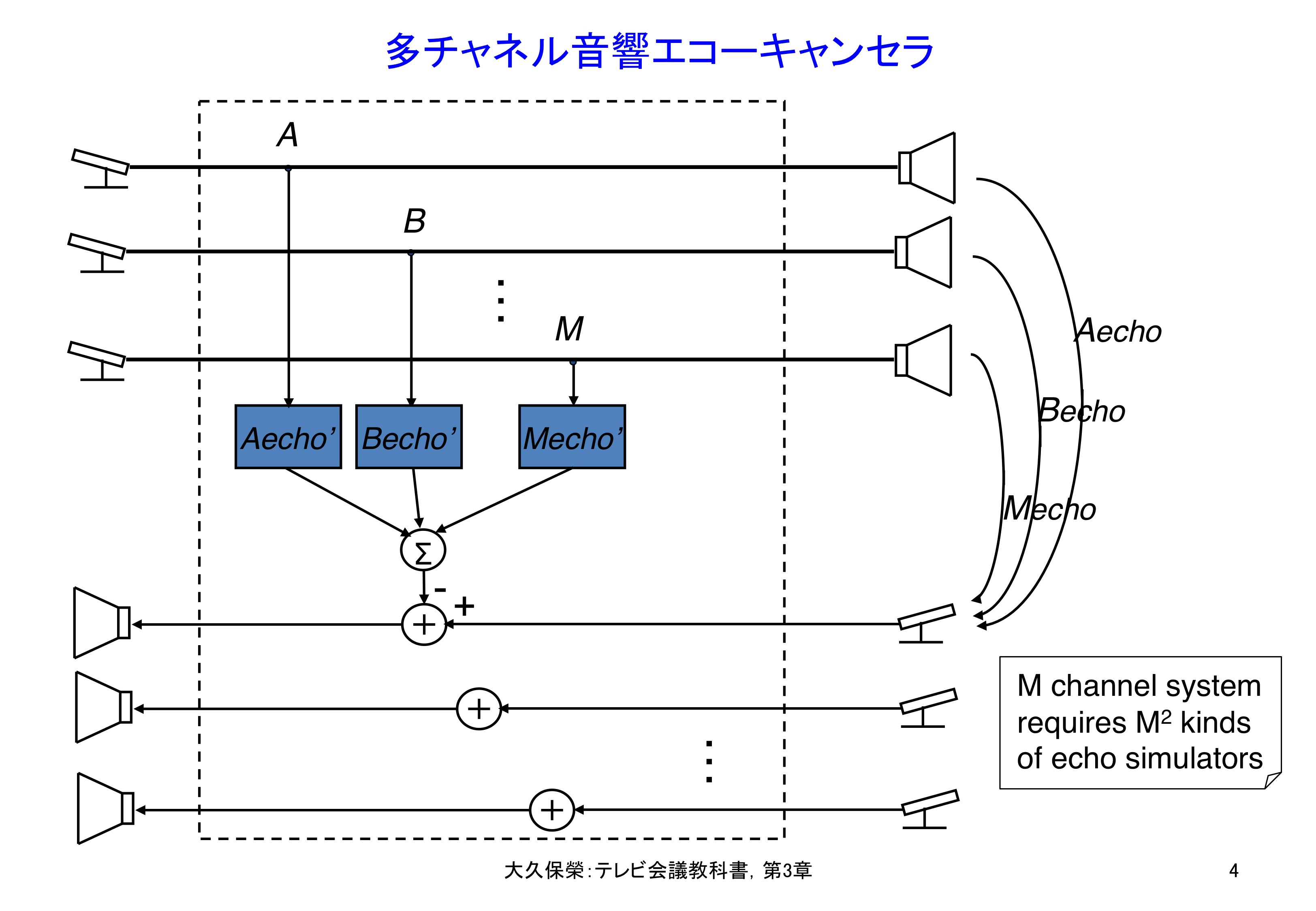

図3-2の音声系には,もう二つの要素,AEC(Acoustic Echo Canceller,音響エコーキャンセラ)と遅延が入っています.

AECは,マイクロフォンとスピーカを用いるときに発生する自分の声が相手会議室から戻ってきてエコーとして聞こえる,あるいはハウリングを生じる問題を解決する手段です.第2.3.9項とコラム2-2で触れましたように,テレビ会議システムの普及に大きな貢献をしています.その動作原理を図3-3に示します[3-3].

スピーカから出て会議室を伝搬しマイクロホンで拾われて戻るエコーを,音響伝搬特性を模擬する電子回路で作り出し,マイクロホン出力から差し引くことで,消去します.これにより,ハウリングすることなく必要なスピーカ出力レベルを確保することができます.

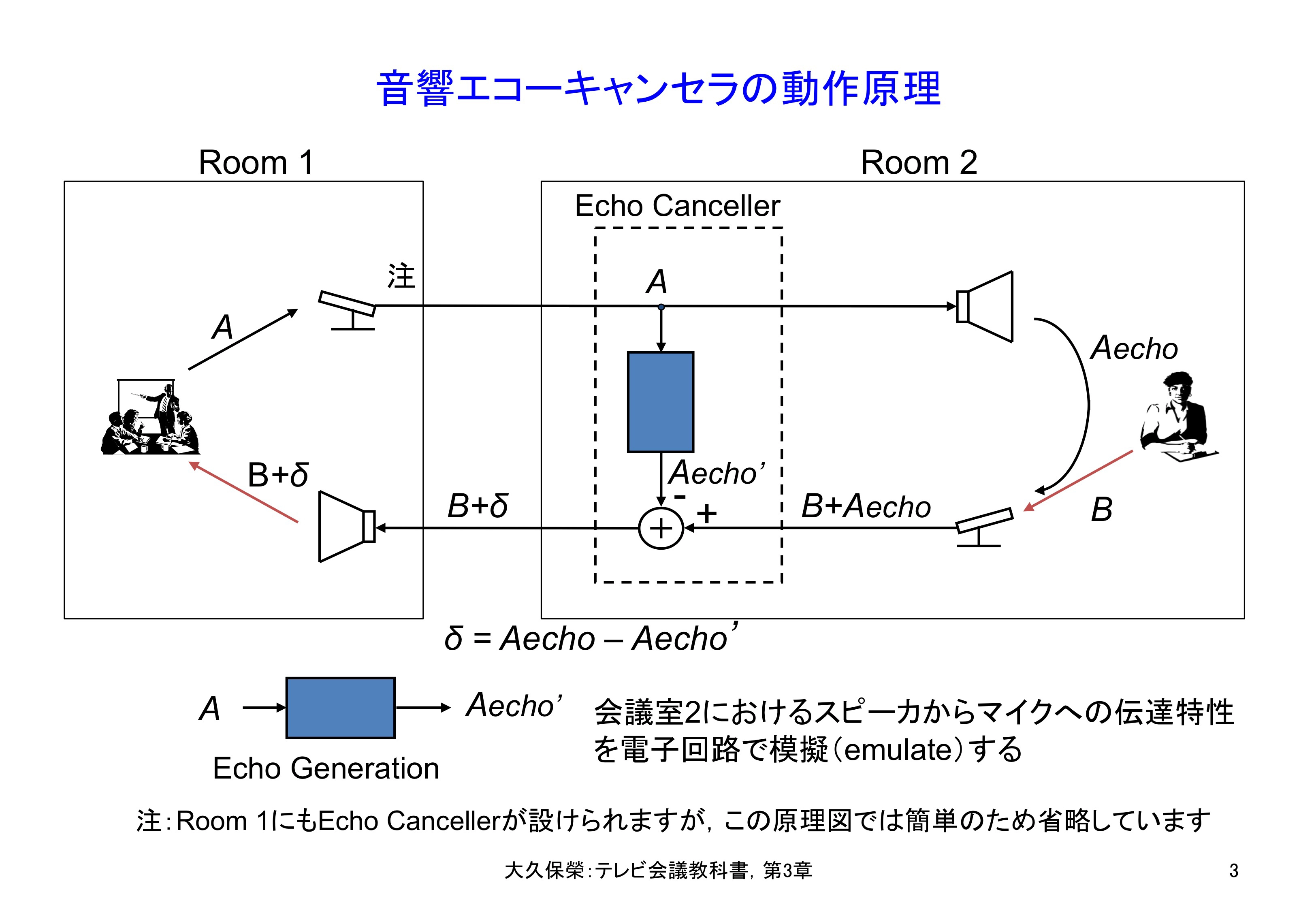

最近ではステレオなど複数音声チャネルを用いるテレビ会議も現れています.この場合のAECは図3-4に示すように,エコー模擬回路が音声チャネル数の自乗個だけ必要になって複雑になりますし,エコー作成が収束できるか理論的にも困難が伴います[3-3][3-4].

一方,遅延の要素は,音声と映像の同期(リップシンク,lip sync)をとるために必要となります.一般に圧縮符号化など音声処理に要する時間は映像処理に要する時間に比べて短く,受信後の音声は映像に先行しますので,音声系に遅延を入れて音声,映像のタイミングを合わせます.送信側と受信側の映像処理遅延は実装で配分が異なりますので,音声系に挿入する遅延は送信側と受信側で独立とします.ただし,音声系に遅延が入ると,会話が不自然になる場合もありますので,音声系に遅延を入れるか否か,入れるとすればどれだけ入れるかは,実装に委ねられます[3-1].